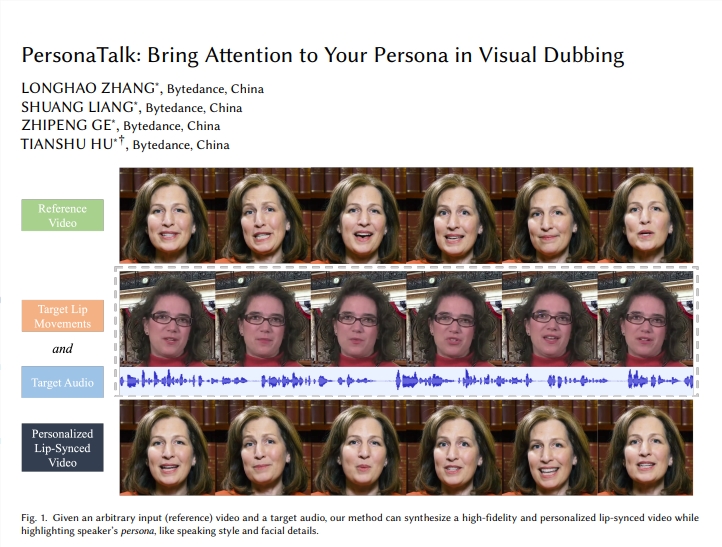

近日,字节跳动研发出一款名为PersonaTalk的前沿AI模型,彻底革新了视频配音技术。它不仅能实现声音与嘴型的精确同步,更能在生成新视频时保留人物的原始说话风格、面部特征及表情,使视频表现得真实自然。

内容概述:

🎤 PersonaTalk的核心能力

- 声音同步嘴型:

- PersonaTalk确保新声音添加时,人物嘴部动作与语音口型完美匹配。无论人物说话、微笑或做其他表情,嘴唇动作均与新语音同步,如同他们真的在说那些话。

- 保留人物特点:

- 创建新视频时,PersonaTalk尽力保留人物原有特点,包括说话方式、脸型及表情。这确保了生成视频的真实感与自然度,避免了僵硬或不协调的情况。

- 适用于不同人物:

- 与传统配音技术不同,PersonaTalk无需大量数据单独训练每个人物,使其能适应不同人物和多样化场景,为视频制作提供了更大的灵活性和便利性。

💡 PersonaTalk的技术原理

PersonaTalk是一个基于注意力机制的两阶段框架,包括几何结构和人脸渲染两部分。

- 第一阶段:

- 使用混合几何估计方法从参考视频中提取说话者的面部几何系数。

- 从目标音频中提取并编码音频特征,学习个性化说话风格,并将其注入音频特征中。

- 根据参考视频的几何系数和目标音频生成与目标音频口型同步且保留个性化说话风格的目标几何图形。

- 第二阶段:

- 使用双重注意力机制的人脸渲染器合成目标说话人脸。

- 采用精心设计的参考选择策略,生成与目标几何图形口型同步的人脸。

🔥 PersonaTalk的优势与挑战

- 显著优势:实验结果表明,PersonaTalk在视觉质量、口型同步精度和人物个性化保留方面均显著优于其他模型。

- 通用性:作为通用模型,PersonaTalk无需微调即可实现与特定人物模型相当的性能。

- 局限性:由于训练数据的局限性,PersonaTalk在驱动非人类化身(如卡通人物)方面的性能可能略低,处理大幅度面部姿势时可能出现伪影。

🔒 防止滥用的措施

为防止技术滥用,字节跳动计划将PersonaTalk核心模型的访问权限限制在研究机构范围内。这一举措确保了该技术的合理应用,推动了AI技术在视频制作领域的健康发展。

© 版权声明

本站所有图文及视频均来源于网络收集,文章均由Ai工具原创编辑,观点仅供参考!如无意中侵犯了某媒体或个人的知识产权,请来信或来电告之,本站将立即给予删除。文章版权归作者所有,未经允许请勿转载。

渝公网安备50011802010872

渝公网安备50011802010872